Ведущий центральный процессор цп

Когда говорят ?ведущий центральный процессор?, многие сразу представляют себе просто самый мощный CPU в сервере. Но в реальной инженерной практике, особенно в промышленных системах управления, всё куда тоньше. Это не всегда про гигагерцы и кэш. Часто речь идёт о роли, об архитектуре распределения задач, и, что критично, о надёжности в условиях постоянной нагрузки. Сам сталкивался с проектами, где заказчик требовал ?самый быстрый процессор? для контроллера, а потом система ?захлёбывалась? не от нехватки вычислительной мощности, а из-за проблем с планировщиком реального времени или латентностью памяти. Вот это и есть ключевой момент: ведущий ЦП — это узел, который не только считает, но и управляет потоком данных, синхронизацией с периферией, а иногда и резервированием. Если этот выбор сделан неправильно, вся архитектура может оказаться неустойчивой.

Архитектурные тонкости и распространённые ловушки

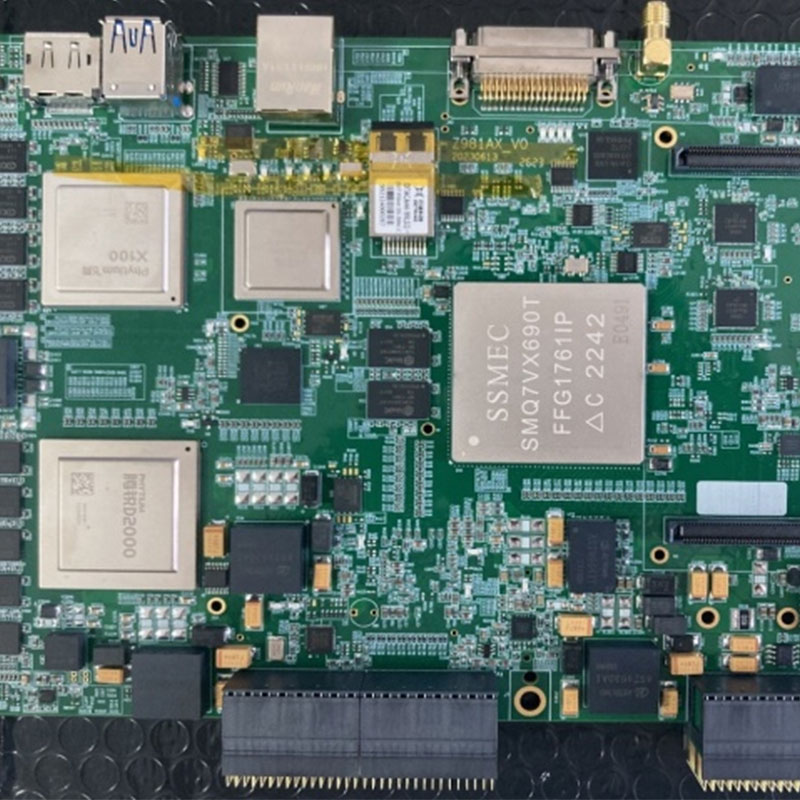

Взять, к примеру, проектирование промышленных управляющих компьютеров. Здесь часто используется гетерогенная архитектура. Ведущий центральный процессор может быть, скажем, на x86-ядре, отвечая за высокоуровневую логику, протоколы связи и интерфейс оператора. А вот обработку сигналов в реальном времени, управление приводами берут на себя выделенные микроконтроллеры или ПЛИС. Ошибка — попытаться всё засунуть на один многоядерный CPU. Кажется, что проще? Но тогда временные характеристики могут ?поплыть? из-за работы ОС. Помню один случай с линией сборки, где задержка в несколько миллисекунд на обработке прерывания от датчика приводила к браку. Пришлось пересматривать всю схему, вынося критичные задачи на отдельный контроллер, а основной CPU оставляя в роли координатора.

Ещё один нюанс — тепловыделение и долговечность. Для офисного ПК это второстепенно, а для шкафа управления в цеху — критично. Выбирая ведущий цп для таких условий, смотришь не на максимальную турбо-частоту, а на TDP в постоянном режиме, на качество корпусирования. Бывало, брали казалось бы подходящую по паспорту модель, но при длительной 80% нагрузке в неидеальном охлаждении начинались троттлинг и сбои. Приходилось либо дорабатывать систему охлаждения, что дорого, либо менять сам кристалл на более термостойкую версию. Это тот опыт, который в даташитах не всегда описан.

И конечно, программная часть. Современный центральный процессор — это не просто кремний. Это драйверы, прошивки, поддержка со стороны вендора. Работая с интеграцией, например, от компании ООО Шицзячжуан Чжунчжичуансинь Технологии, которая как раз занимается продажей промышленных управляющих компьютеров и интеграцией систем, понимаешь ценность готовых, отлаженных решений. Их сайт https://www.zzcxkj.ru — это каталог не просто железа, а часто уже проверенных комбинаций ?процессор + материнская плата + ПО?. Для инженера это сокращает цикл отладки. Самому собирать из компонентов — это месяцы тестов на соответствие стандартам (того же EMC), а готовый промышленный компьютер от такого поставщика часто уже сертифицирован. Но и тут есть подводные камни: нужно чётко понимать, какие именно драйверы и версии ядра ОС идут в комплекте, чтобы потом не оказаться в ситуации, когда необходимое ПО для кастомного оборудования несовместимо.

Кейсы из практики: от успехов до неудач

Расскажу про проект автоматизации небольшого участка гальванической линии. Задача — управление температурой, уровнем электролита, подачей тока. Изначально архитектура была централизованной: один достаточно производительный промышленный ПК с многоядерным CPU собирал данные со всех датчиков через разношёрстные интерфейсы (RS-485, аналоговые входы) и выдавал управляющие сигналы. Ведущий процессор был загружен на 30-40% в среднем, казалось бы, запас огромный. Но в моменты одновременного опроса нескольких датчиков и запуска цикла коррекции происходили кратковременные пики нагрузки, и система управления температурой давала ?просадку? — регулятор не успевал пересчитываться. Визуально на графиках это были едва заметные ?иголки?, но для процесса они оказались критичны — страдало качество покрытия.

Решение было не в апгрейде CPU, а в изменении архитектуры. Мы добавили локальные шлюзы-контроллеры на каждой группе датчиков. Их задача — предварительная агрегация и фильтрация данных. Теперь ведущий центральный процессор основного компьютера получал уже готовые, усреднённые пакеты раз в 100 мс, а не сырой поток. Его нагрузка упала до 10-15%, но главное — исчезли пики. Планировщик ОС перестал ?дергаться?, и временные характеристики выровнялись. Это классический пример, когда ?мощность? — понятие системное, а не только тактовая частота ядра.

А был и обратный, менее удачный опыт. Пытались для системы мониторинга энергопотребления использовать в качестве ведущего CPU маломощный, но очень энергоэффективный ARM-процессор от встраиваемой платы. Логика была в экономии и отказе от активного охлаждения. Но не учли объём и скорость обработки данных с десятков счётчиков по Modbus TCP. Процессор буквально ?тонул? в прерываниях от сетевого контроллера и парсинге протокола. Пришлось срочно искать замену на x86-аналог с большей производительностью на одном потоке. Вывод: для задач с интенсивным сетевым или протокольным взаимодействием архитектура и набор инструкций CPU имеют огромное значение. Энергоэффективность хороша, но только когда она адекватна задаче.

Взаимодействие с другими компонентами и будущие тренды

Сегодня ведущий цп редко работает в вакууме. Всё чаще речь идёт о связке с ускорителями: GPU для алгоритмов машинного зрения в контроле качества, или FPGA для предобработки сигналов. Здесь возникает новая задача — эффективный обмен данными. Шина PCI Express становится критичным местом. Недооценив её пропускную способность или latency, можно свести на нет преимущества мощного CPU и быстрого акселератора. В одном из проектов по оптическому распознаванию дефектов мы столкнулись с тем, что CPU (довольно серьёзный Xeon) простаивал, ожидая данных от камеры высокого разрешения через карту захвата. ?Бутылочным горлышком? оказалась не вычислительная часть, а пропускная способность шины и драйверы. Пришлось переходить на систему с большим количеством линий PCIe и тщательно настраивать драйвер DMA.

Если смотреть на деятельность компании ООО Шицзячжуан Чжунчжичуансинь Технологии, то видно, что их сфера — это комплексные решения. Разработка ПО, проектирование интегральных схем, продажа силовых электронных компонентов — всё это звенья одной цепи. Ведущий центральный процессор в их контексте — это ядро, вокруг которого строится вся эта экосистема. Например, их промышленные компьютеры могут поставляться с предустановленным ПО для управления, которое уже оптимизировано под конкретные линейки CPU. Это снижает порог входа для клиента, но накладывает ответственность на интегратора: нужно точно оценить, хватит ли производительности выбранной платформы под будущий рост функционала. В их описании есть и передача технологий — это как раз про то, чтобы не просто продать ?железо?, а передать ноу-хау по его эффективному использованию в связке с другим оборудованием.

Куда всё движется? На мой взгляд, тенденция — дальнейшая специализация. Уже сейчас появляются CPU со встроенными областями для задач ИИ или изоляцией критичных процессов на аппаратном уровне. Для промышленности это может означать консолидацию: одна физическая плата с ведущим CPU, где часть ядер выделена под детерминированное реальное время, часть — под Linux для сетевых задач, и есть аппаратный ускоритель для предиктивной аналитики. Выбор такого центрального процессора будет ещё сложнее, но и потенциальная отдача выше. Главное — не гнаться за модными терминами, а чётко соотносить архитектурные особенности чипа с реальными требованиями процесса: временными циклами, надёжностью, условиями эксплуатации. Иногда проверенное поколение процессоров, на котором ?всё уже отлажено?, оказывается выигрышнее самого нового, но сырого решения.

Заключительные мысли: практика против спецификаций

В итоге, работа с ведущим центральным процессором — это постоянный баланс между теорией (техническими характеристиками) и практикой (поведением в реальной системе). Датушит говорит об одной производительности, а реальная нагрузка с драйверами и фоновыми процессами ОС даёт совсем другую картину. Самый важный навык — не просто прочитать спецификации, а спрогнозировать, как CPU поведёт себя в конкретной инженерной задаче.

Опыт, в том числе и негативный, как с теми историями перегрева или неверной архитектуры, бесценен. Он заставляет смотреть на ведущий цп не как на абстрактный компонент, а как на часть живой системы, которая дышит данными, греется, потребляет энергию и должна работать годами без сбоев. Именно поэтому сотрудничество с поставщиками, которые понимают этот контекст, как та же ООО Шицзячжуан Чжунчжичуансинь Технологии, может сэкономить массу времени. Они часто уже прошли часть пути по тестированию и валидации связок ?процессор-периферия-ПО?.

Так что, если резюмировать: выбор ведущего процессора — это не поиск самой большой цифры в столбце ?частота?. Это системная инженерная задача, где учитывается всё: от теплового режима и надёжности поставок компонентов до совместимости с legacy-оборудованием и будущей масштабируемости. И лучший совет здесь — тестировать в условиях, максимально приближенных к боевым, ещё на этапе прототипа, и всегда иметь в виду план ?Б? на случай, если выбранный CPU не потянет неожиданно возникшую нагрузку. В этом и есть суть практической работы — в готовности к тому, что реальность всегда сложнее самой подробной технической документации.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

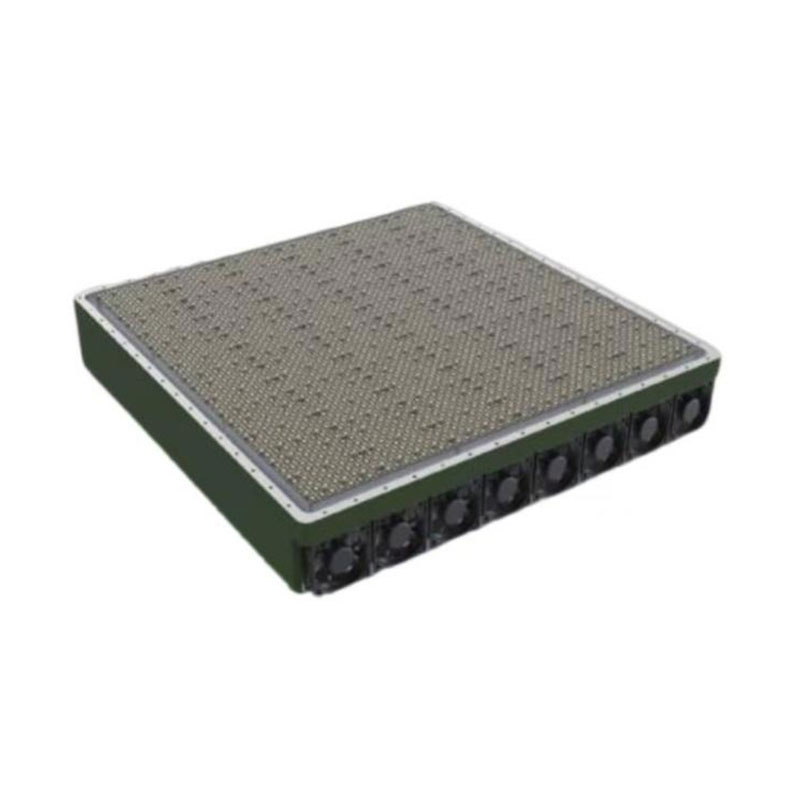

Модуль TR Ku-диапазона, 2D фазированная решетка

Модуль TR Ku-диапазона, 2D фазированная решетка -

HEG197U

HEG197U -

Электронный трансформатор и индуктор

Электронный трансформатор и индуктор -

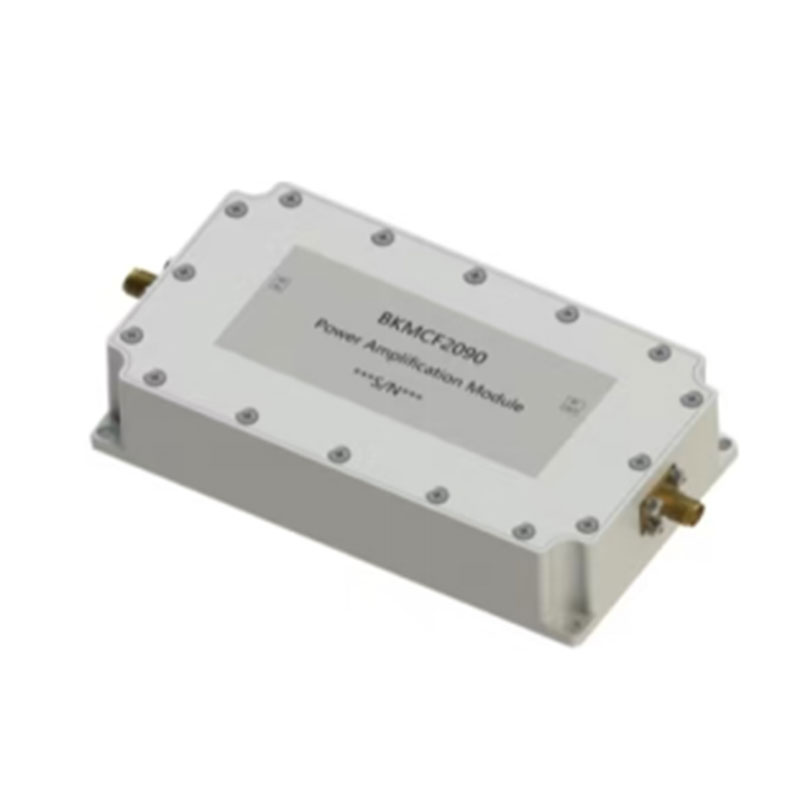

Модуль усилителя мощности (широкополосный)

Модуль усилителя мощности (широкополосный) -

Система на кристалле (SoC) Loongson 2P0500

Система на кристалле (SoC) Loongson 2P0500 -

Усилитель мощности — S-диапазон ZPA2700M3500-100

Усилитель мощности — S-диапазон ZPA2700M3500-100 -

Передняя часть передачи радиочастот с фазированной антенной решеткой Ка-диапазона

Передняя часть передачи радиочастот с фазированной антенной решеткой Ка-диапазона -

M5S5C1R

M5S5C1R -

H28MXA380W

H28MXA380W -

M28S5C25X

M28S5C25X -

YXW9009

YXW9009 -

Микроконтроллер Loongson 1D100

Микроконтроллер Loongson 1D100

Связанный поиск

Связанный поиск- Электронные драйверы

- Ведущий схемы микросхем производители

- Модуль поставщик

- Основа интегральных схем поставщики

- Ведущий магнетрон

- Статор электродвигателя производители

- Китай центральный процессор цп

- Элементная база интегральные схемы поколение поставщики

- Китай рч приёмопередатчик трансивер производители

- Усилитель мощности драйвера поставщики