Ведущий центральный процессор cpu

Когда говорят ?ведущий центральный процессор?, многие сразу представляют себе просто самый мощный CPU в сервере. На практике же всё часто оказывается сложнее — это не только вопрос тактовой частоты или количества ядер. Речь идёт о процессоре, который берёт на себя ключевую роль в управлении шинами, распределении задач между другими вычислительными узлами и, что критично, в обеспечении отказоустойчивости. В системах промышленной автоматизации, с которыми я чаще всего сталкивался, неправильное понимание этой роли ведёт к простоям. Видел проекты, где инженеры ставили самый дорогой Xeon, но конфигурация ПО и периферии была такой, что он работал вхолостую, а реальную нагрузку несли другие контроллеры. Получалась дорогая, но неустойчивая архитектура.

От теории к стойке: как выбирали CPU для проекта автоматизации

Помню один конкретный кейс лет пять назад — нужно было спроектировать управляющий вычислительный узел для линии сборки. Заказчик изначально требовал ?максимальную надёжность?, но бюджет был ограничен. Сразу возникла дилемма: брать специализированный промышленный компьютер с запаянным процессором или собирать свою платформу на базе серверного CPU. Специализированные решения, например от Advantech, дают стабильность, но их апгрейд почти невозможен. Серверный же CPU, тот же Intel Core i7 или Xeon E3, позволял гибче масштабировать память и периферию.

В итоге склонились к серверному варианту, но с оговорками. Ключевым стал не сам CPU, а чипсет и поддержка ECC-памяти. Мы выбрали платформу, где ведущий центральный процессор напрямую управлял PCIe шиной для плат ввода-вывода и имел встроенный контроллер LAN с приоритезацией трафика. Это важно: если сетевой контроллер висит на южном мосту, задержки могут быть непредсказуемыми. А в реальном времени это сбой.

Тут стоит сделать отступление про одну частую ошибку. Многие смотрят на TDP (тепловыделение) процессора как на главный параметр для промышленной среды. Да, охлаждение важно, но часто упускают из виду энергопотребление в режиме простоя (idle state) и скорость перехода между состояниями C-states. На той линии сборки были циклы простоя оборудования. Процессор, который быстро и ?глубоко? засыпает, экономил энергию, но при пробуждении возникала задержка в 10-15 мс, что для синхронизированных конвейеров было неприемлемо. Пришлось тонко настраивать политики управления питанием в BIOS, фактически жертвуя частью энергоэффективности ради детерминизма. Это тот нюанс, который в даташитах пишут мелким шрифтом, а узнаёшь только на практике.

Провал и урок: когда резервирование CPU не сработало

Был и откровенно неудачный опыт. Заказчик хотел систему с горячим резервированием (hot-swap) ведущих CPU. Концепция звучала надёжно: два идентичных процессора на одной плате с мгновенным переключением при отказе. Использовали довольно нишевое решение на базе процессоров ARM. Теория гласила, что синхронизация состояния происходит через общую память.

На стенде всё работало. Но в цеху, с его электромагнитными помехами и вибрациями, начались сбои. Выяснилось, что механизм синхронизации кэшей между двумя центральными процессорами был чувствителен к скачкам напряжения на шине. В один ?прекрасный? момент оба процессора ушли в latch-up из-за помехи, и вся система встала. Резервирование оказалось фиктивным. Пришлось срочно откатываться на классическую схему с двумя физически раздельными вычислительными узлами, где каждый имел свой ведущий CPU и они общались по защищённому каналу. Дороже, менее элегантно, но работало. Главный вывод: избыточная сложность на низком уровне часто вредит надёжности. Иногда лучше два простых независимых блока, чем одна умная, но хрупкая схема.

Современный контекст и периферия: куда движется архитектура

Сейчас тренд — это не просто raw performance, а интеграция. Взять, к примеру, современные процессоры Intel Core 12-го/13-го поколения или AMD Ryzen Embedded. В них появилось много того, что раньше требовало отдельных контроллеров: больше линий PCIe 4.0/5.0, встроенная графика, способная выводить на несколько дисплеев HMI, аппаратная поддержка виртуализации для изоляции критических и некритических задач на одном CPU.

Это меняет подход к проектированию. Раньше для подключения, скажем, платы захвата видео и нескольких сетевых карт требовался сложный мостовой чип, который становился узким местом. Теперь ведущий процессор может сам обслуживать эти устройства напрямую, снижая задержки. Но есть и обратная сторона: такая интеграция делает систему менее гибкой. Если нужна специфическая периферия, не поддерживаемая напрямую CPU, приходится снова городить мосты, сводя на нет преимущества.

В этом контексте интересно смотреть на компании, которые занимаются именно интеграцией решений, а не просто продажей ?железа?. Вот, например, ООО Шицзячжуан Чжунчжичуансинь Технологии (сайт: https://www.zzcxkj.ru). Их сфера — это как раз технические услуги, разработка, интеграция систем. Из описания видно, что они охватывают цепочку от проектирования интегральных схем и ПО до продажи промышленных управляющих компьютеров. Для такой компании правильный выбор и конфигурация ведущего центрального процессора — это не абстракция, а ежедневная практика. Они, вероятно, сталкиваются с тем, что нужно подобрать CPU под конкретную задачу клиента: будет ли это управление станком (жёсткое реальное время) или сбор данных с датчиков (большой поток ввода-вывода). Универсального ответа нет, и их техническое консультирование как раз, наверное, в этом и заключается — помочь клиенту не переплатить за ненужные гигагерцы, но и не угробить проект слабым звеном.

Практические советы и заключительные мысли

Исходя из своего опыта, сформировал несколько неочевидных правил. Во-первых, всегда тестируй предполагаемую конфигурацию CPU под пиковой нагрузкой не на синтетических бенчмарках, а на симуляции реального рабочего профиля. Часто ?узким местом? становится не вычислительное ядро, а пропускная способность памяти или шины. Во-вторых, обращай огромное внимание на драйверы и поддержку со стороны вендора ОС. Бывало, что для промышленного дистрибутива Linux драйвер какого-нибудь нового энергосберегающего режима CPU выходил с задержкой в полгода.

В-третьих, не забывай про долгосрочную доступность компонентов. Выбрал ты модный, мощный CPU, а через два года его снимают с производства. Для промышленного проекта, который должен работать 10-15 лет, это катастрофа. Иногда логичнее взять чуть менее производительный, но из линейки long-term supply.

В итоге, ведущий центральный процессор — это всегда компромисс. Компромисс между производительностью, надёжностью, энергопотреблением, стоимостью владения и будущей расширяемостью. Его выбор — это не техническая справка по спецификациям, а часть инженерного искусства, где учтены и физика, и экономика, и даже логистика цепочки поставок. И самое интересное, что идеального выбора не существует — есть только наиболее подходящий для конкретной задачи в конкретных условиях. Именно этим, как я понимаю, и занимаются в той же ООО Шицзячжуан Чжунчжичуансинь Технологии, решая задачи клиентов от проектирования ?железа? до его внедрения. А CPU в этом — всего лишь главный, но не единственный инструмент.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

XZPM4644M

XZPM4644M -

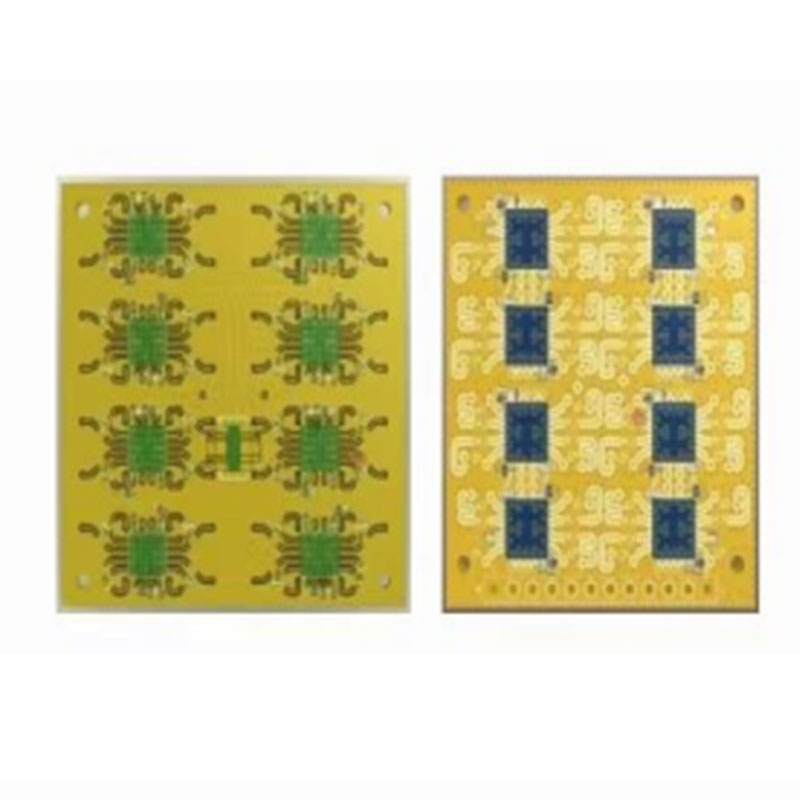

Система на кристалле (SoC) Loongson 2P0500

Система на кристалле (SoC) Loongson 2P0500 -

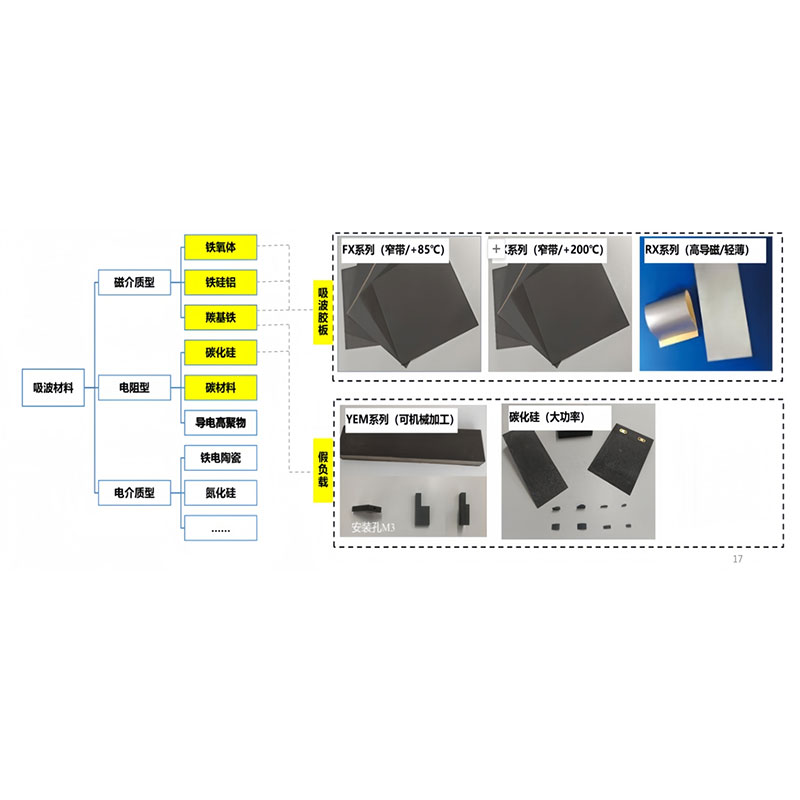

Радиопоглощающий материал

Радиопоглощающий материал -

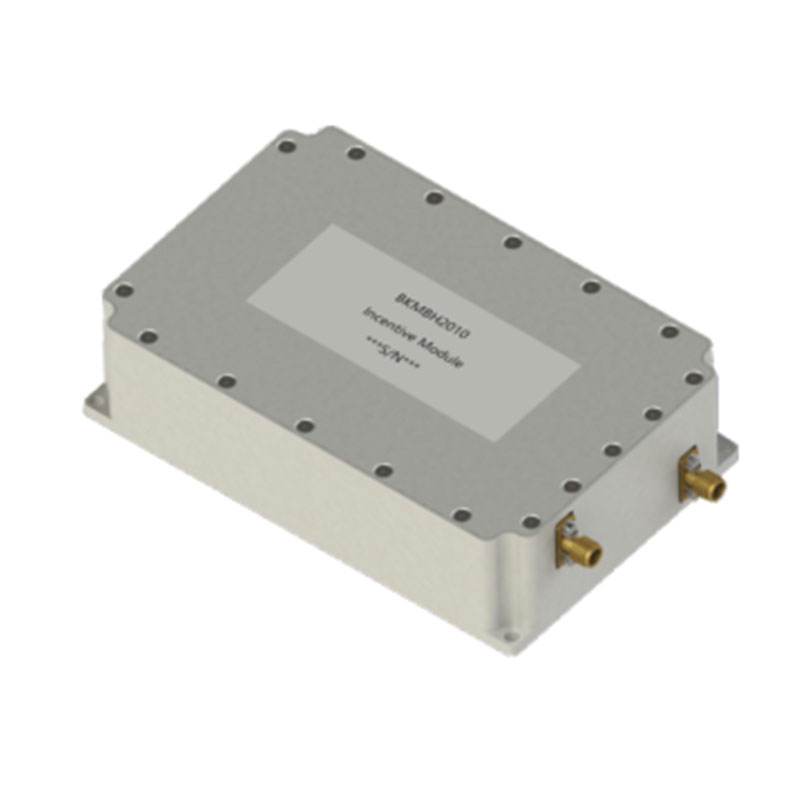

Силовой модуль M12S100AIR-GC

Силовой модуль M12S100AIR-GC -

STD3256M16

STD3256M16 -

Микроконтроллер Loongson 1D100

Микроконтроллер Loongson 1D100 -

HEG891A

HEG891A -

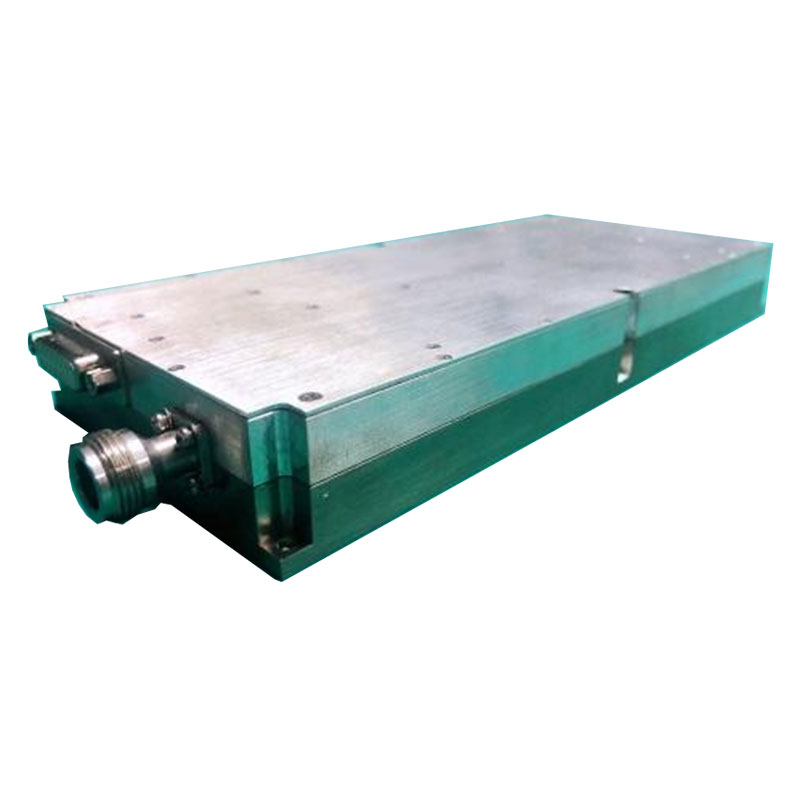

Усилитель мощности — L-диапазон ZPA1200M1400-550

Усилитель мощности — L-диапазон ZPA1200M1400-550 -

Интегральный широкополосный усилитель HE380

Интегральный широкополосный усилитель HE380 -

Усилитель мощности ZPA960M1250-1000/1500

Усилитель мощности ZPA960M1250-1000/1500 -

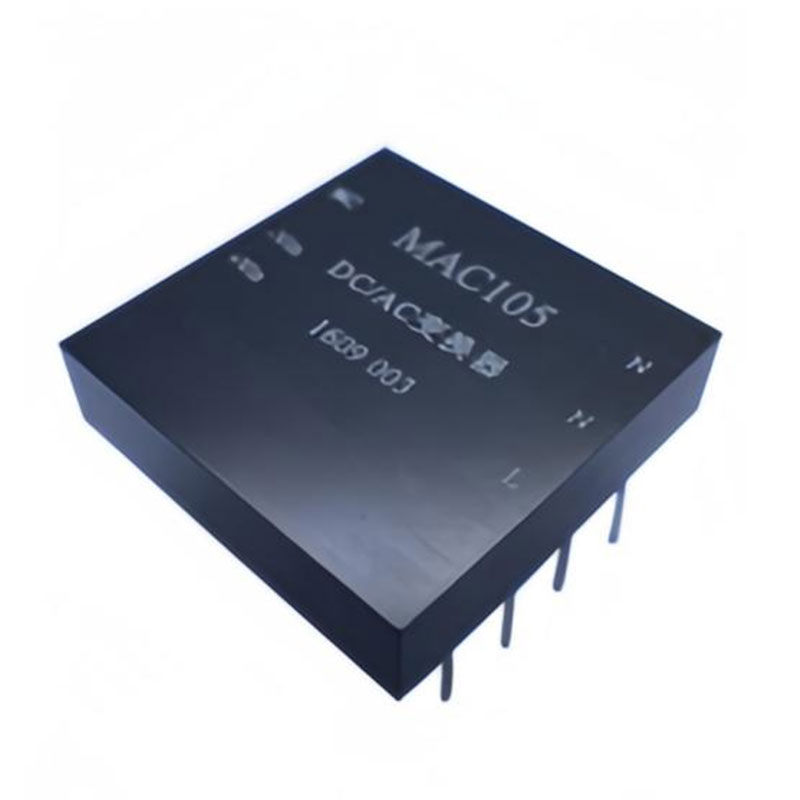

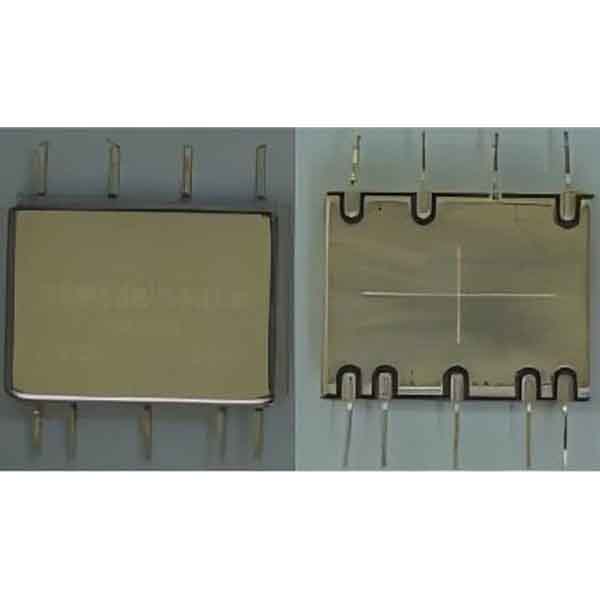

Модульный источник питания

Модульный источник питания -

Двухкристальный кварцевый генератор серии TXM88 с температурной компенсацией и защитой от вибраций

Двухкристальный кварцевый генератор серии TXM88 с температурной компенсацией и защитой от вибраций

Связанный поиск

Связанный поиск- Китай малошумящий усилитель производитель

- Китай малошумящий усилитель

- центральное устройство процессор

- Ведущий большие интегральные схемы поставщик

- Китай статор электродвигателя производители

- Ведущий источник опорной частоты производитель

- Ведущий электронные измерительные преобразователи производитель

- Китай электронный аттенюатор поставщик

- Ведущий схема интегральных транзисторов производители

- Ведущий индуктор производители